Sztuczna inteligencja intensywnie wkracza w testowanie oprogramowania. Narzędzia generujące kod testów, pomagające formułować przypadki testowe czy analizować wyniki stają się powszechne. Przy odpowiednim użyciu mogą usprawnić powtarzalne zadania i odciążyć testerów. Jednak szybkie tempo przyrostu możliwości AI rodzi pytanie mniej dyskutowane, choć nadal istotne: kiedy zysk na szybkości zaczyna zamieniać się w koszt utrzymania, zrozumiałości i jakości? Przyglądamy się mechanizmom, poprzez które AI przyczynia się do powstawania długu technicznego, jak ten dług się manifestuje i jak testerzy mogą go identyfikować i kontrolować.

Czym jest dług techniczny w kontekście AI

W klasycznym rozumieniu dług techniczny to konsekwencja decyzji, które upraszczają pracę teraz kosztem większego nakładu pracy w przyszłości. Takie kompromisy pojawiają się w kodzie, architekturze, dokumentacji, procesach i testach. Gdy testerzy lub programiści podejmują decyzje projektowe bez głębszej analizy, łatwo tworzą „ukrytą” zaległość, która później domaga się refaktoryzacji, dodatkowych testów i korekt.

Dług techniczny związany z AI nie dotyczy tylko błędów w logice czy deklaracji testów. Obejmuje także problemy strukturalne, takie jak struktura kodu i testów, które zadziałały raz, ale są trudne do utrzymania; zależności od bibliotek czy wzorców, których nie rozumieją sami „prompterzy” i członkowie zespołu; generowane testy, które nie wiadomo jak działają i czy rzeczywiście cokolwiek sprawdzają.

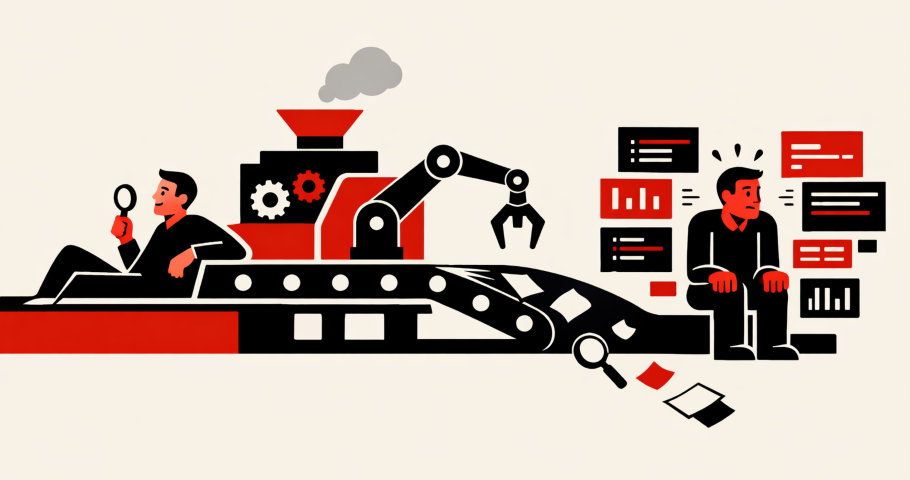

Pozorna produktywność i jej konsekwencje

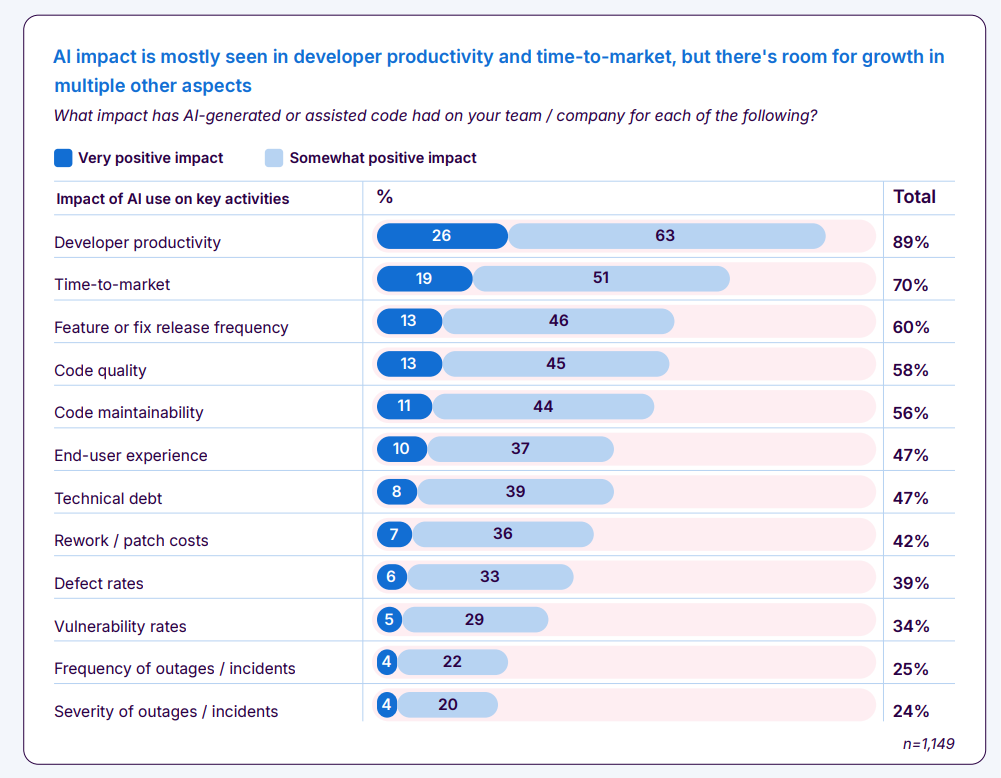

Raporty i analizy pokazują, że narzędzia AI rzeczywiście przyspieszają wykonywanie zadań (generowanie kodu czy zautomatyzowanych skryptów testowych może być wielokrotnie szybsze niż praca manualna). Jednocześnie wzrasta liczba wad produkcyjnych, a wskaźniki reworku (czyli konieczności poprawiania defektów lub poprawiania poprawek po wydaniu itd.) rosną, ponieważ automatycznie generowane wyniki generatywnej AI często nie uwzględniają kontekstu projektu ani jakościowych kryteriów. Co z tego, że potencjalnie zwiększyło się pokrycie, skoro jest ono jedynie deklaratywne.

Choć AI przyspiesza dostarczanie oprogramowania (70% wskazań), jego wpływ na jakość, utrzymanie i dług techniczny jest znacznie mniej jednoznaczny, często poniżej 50% pozytywnych odpowiedzi.

Nawet jeśli narzędzia AI są w stanie tworzyć testy lub fragmenty kodu szybciej, to ich rezultaty często wymagają jeszcze rewizji, usunięcia defektów lub doprecyzowania weryfikatorów w scenariuszach. Zespół może początkowo odnieść wrażenie, że projekt jest szybszy. Jednak po kilku sprintach większość czasu zaczyna pochłaniać poprawianie i dostrajanie tego, co AI „wygenerowało”, a zespół „puścił” dalej. To właśnie jest istota długu technicznego, który kumuluje się wraz z kolejnymi iteracjami.

Symptomy długu technicznego generowanego przez AI

Jednym z najczęściej obserwowanych objawów jest narastająca liczba podobnych do siebie fragmentów kodu testów lub kodu aplikacji (tzw. duplikacja). Narzędzia do generowania wykorzystujące AI optymalizują lokalne rozwiązania, co może skutkować wprowadzeniem powielonych wzorców bez uwzględnienia architektonicznych konsekwencji.

Innym symptomem jest brak obsługi scenariuszy nietypowych lub skrajnych przypadków. AI „widzi” dane, które często pojawiają się w zbiorach treningowych, i proponuje rozwiązania, które działają w najczęstszych przypadkach, ale pomijają specyficzne warunki. Takie testy lub fragmenty kodu wydają się poprawne, dopóki nie pojawi się krytyczny scenariusz produkcyjny.

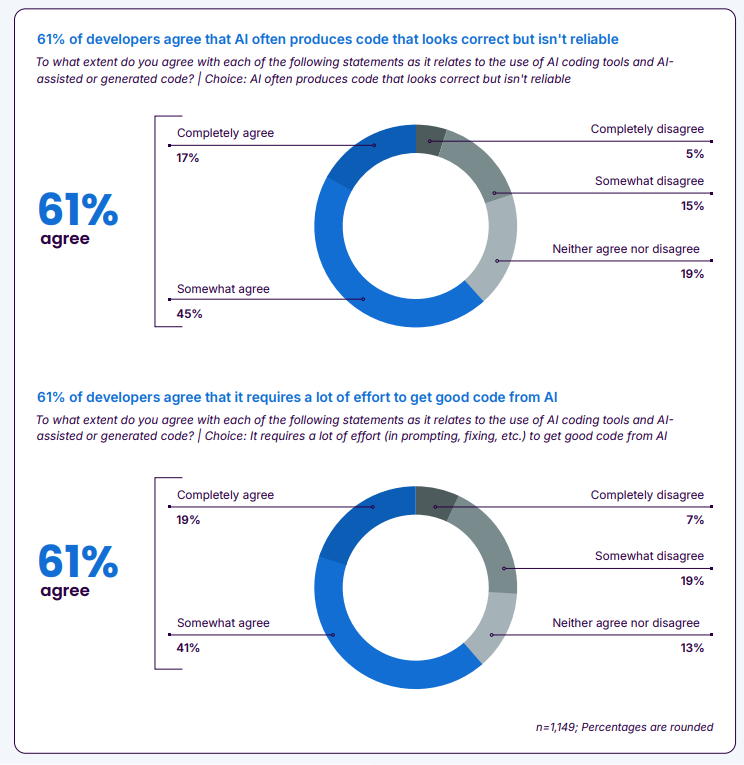

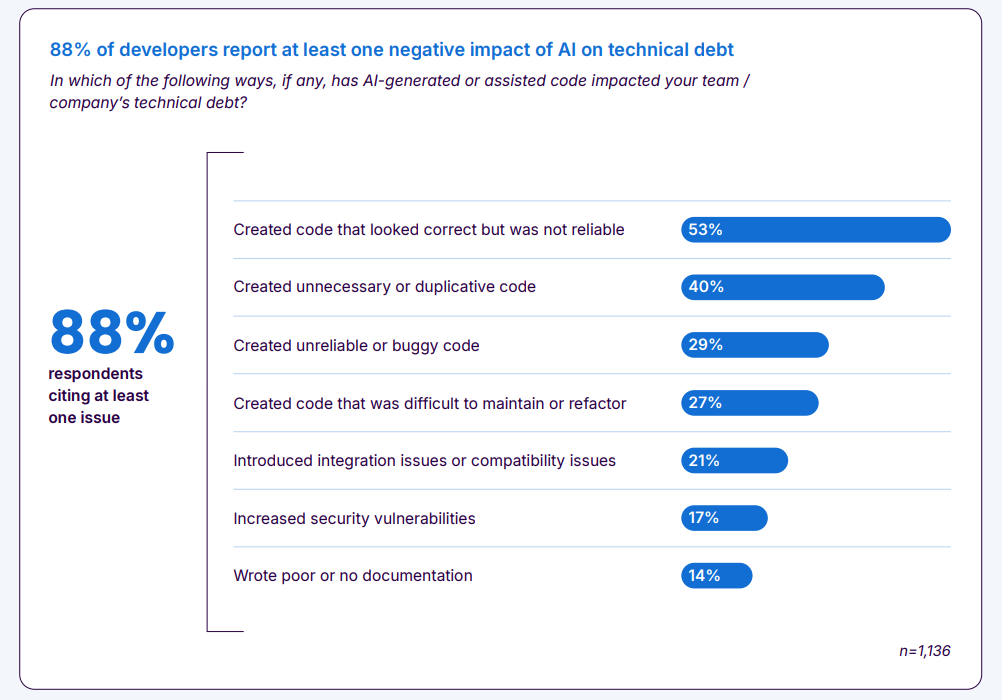

W badaniu 88% zespołów wskazało co najmniej jeden negatywny wpływ AI na dług techniczny. Najczęstsze problemy to kod, który wygląda poprawnie, ale nie jest niezawodny (53%) oraz duplikacja (40%).

Rosnąca złożoność oraz trudność w utrzymaniu testów wygenerowanych przy pomocy AI także wskazuje na dług techniczny. Testy bez wyraźnej struktury, zależne od środowisk czy narzędzi, które same nie są dobrze udokumentowane, stają się po czasie ciężarem. To prowadzi do sytuacji, w której testerzy bardziej walczą z automatycznie wygenerowanym materiałem niż faktycznie analizują ryzyka i zapewniają jakość. W którymś momencie wydaje się, że lepsze od utrzymania staje się przepisanie. Kojarzycie ten problem z przeszłości? Dotyczył narzędzi nagrywająco-odtwarzających. I choć dziś kod generatywnej AI jest o niebo lepszy to jednak zespoły często na własne życzenie rezygnują z jego kontroli jakości. Pojawia się syndrom zbyt dużego zaufania do wygenerowanego kodu, albo problem szybkiego zaspokojenia oczekiwań.

Dlaczego AI generuje dług techniczny

Samo narzędzie AI nie wybiera, by tworzyć zły kod. Problem wynika z tego, że modele generatywne optymalizują się pod lokalne uwarunkowania. Próbują dopasować się do wymogów syntaktycznej poprawności, a nie globalnej spójności architektonicznej i strategii długofalowej jakości. To prowadzi do sytuacji, w której kod lub test ma poprawną postać, ale ignoruje reguły projektowe lub standardy obowiązujące w zespole.

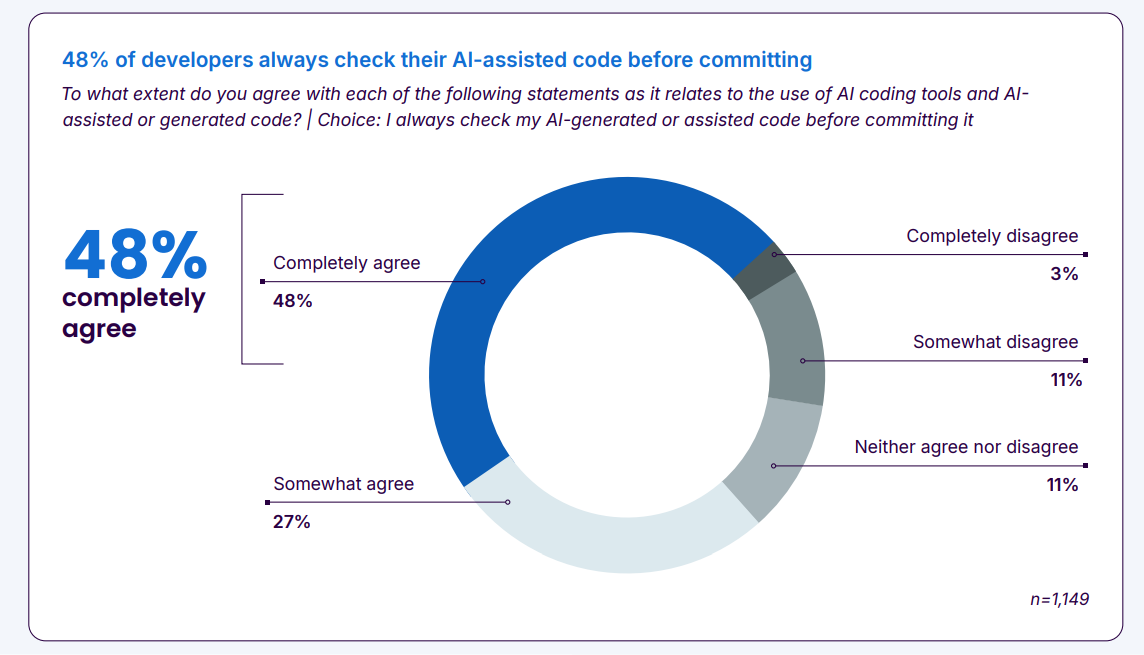

Dodatkowo, jeśli zespoły traktują AI jako środek do „szybkiego dostarczenia” bez procesów nadzoru i weryfikacji, powstaje luka między tym, co narzędzie proponuje, a tym, co jest faktycznie wartościowe dla produktu. Z badania firmy Sonar wynika, że choć wielu programistów używa narzędzi generatywnych codziennie, to mniej niż połowa regularnie weryfikuje kod AI przed jego zatwierdzeniem. To prowadzi do narastania tzw. „długu weryfikacyjnego”, który jest specyficznym aspektem długu technicznego.

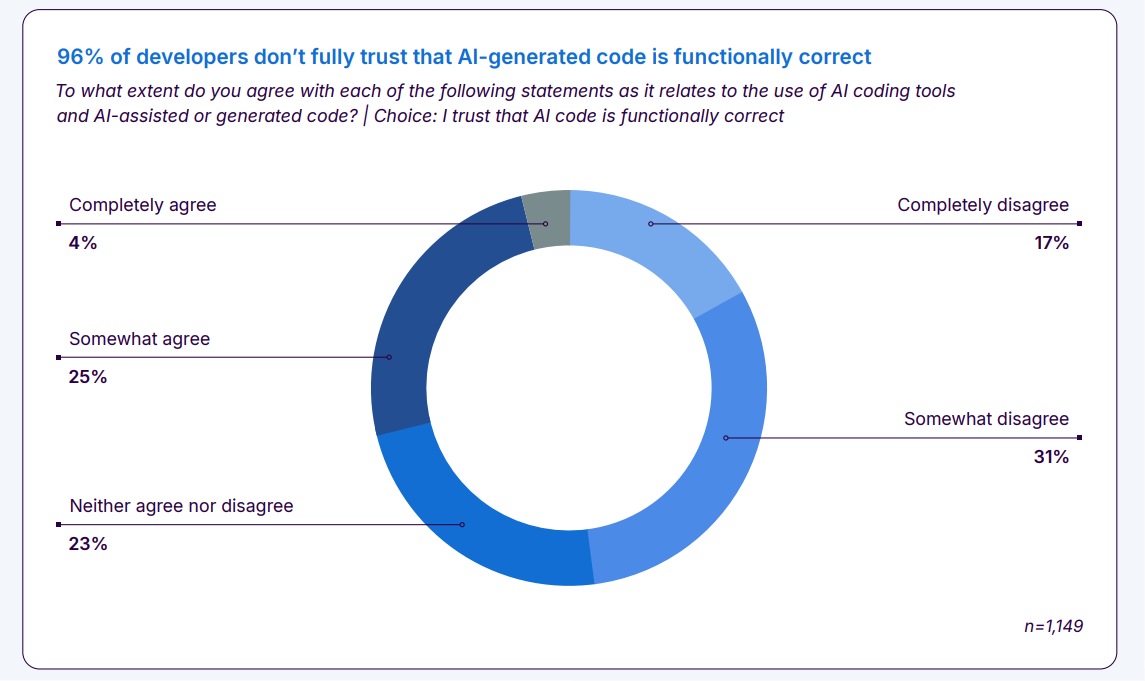

Dane pokazują wyraźną lukę między generowaniem a weryfikacją. 96% programistów nie ufa kodowi AI, jednak tylko 48% deklaruje, że zawsze go sprawdza. Powstaje w ten sposób przestrzeń, w której kumuluje się dług weryfikacyjny.

Kontrola i ograniczanie długów technicznych z użyciem AI

Nie oznacza to jednak, że AI trzeba eliminować z procesu testowania. Rozsądne zastosowania narzędzi generatywnych mogą wspierać pracę testerów, jeśli towarzyszy im odpowiednia kontrola. Ważna jest transparentność i świadomość, że generowane wyniki to propozycje, które wymagają przeglądu przez człowieka.

Testy AI warto traktować jak szkice: są one punktem wyjścia, ale muszą przejść przez kontrolę norm projektu, standardy jakości i pełną walidację scenariuszy. To ogranicza gromadzenie się długu technicznego i minimalizuje problemy z utrzymaniem. Innym krokiem jest włączenie AI do analiz architektonicznych i refaktoryzacji – nie tylko generowanie nowych treści, ale też sugerowanie usprawnień i wykrywanie anomalii w istniejących testach i kodzie.

Rola testera w erze AI

Testerzy powinni rozwijać kompetencje, które pozwalają im krytycznie oceniać wyjścia narzędzi AI. To wymaga zrozumienia architektury systemu, kontekstu biznesowego, zależności między komponentami oraz umiejętności przewidywania możliwych skutków wprowadzanych zmian. Bez takiego kontekstu nawet najlepsza automatyczna generacja pozostanie krótkoterminowym zyskiem kosztem jakości.

Podsumowując, AI w testowaniu nie jest magią, która usunie wszystkie trudności związane z jakością. Może wspierać procesy i odciążyć z powtarzalnych zadań, ale jeśli zostanie użyta bez refleksji i kontroli, łatwo stanie się mechanizmem narastania długu technicznego, który jest niewidoczny na początku, ale kosztowny w utrzymaniu projektu w dłuższej perspektywie.

Redakcja

Redakcja