LLM-y bardzo szybko przeszły drogę od technologicznej ciekawostki do elementu realnych produktów. Dziś generują treści, wspierają obsługę użytkowników i automatyzują zadania, które jeszcze niedawno wymagały pracy człowieka. Samo zbudowanie prototypu nie stanowi już większego wyzwania – wystarczy dostęp do gotowego modelu i podstawowa integracja. Problem zaczyna się dopiero wtedy, gdy rozwiązanie trafia na produkcję i musi działać powtarzalnie, przewidywalnie oraz obsługiwać dużą skalę użytkowników.

Największym wyzwaniem nie jest więc samo wykorzystanie modelu, ale utrzymanie jakości jego działania w czasie. Odpowiedzi mogą się zmieniać, pojawiają się defekty trudne do jednoznacznej oceny, a drobne modyfikacje potrafią wpływać na cały system. W tym miejscu pojawia się LLMOps, czyli podejście, które porządkuje pracę z modelami językowymi i daje opcję przekształcenia eksperymentalnych rozwiązań w stabilne, utrzymywalne produkty.

Modele językowe a klasyczne modele ML

Modele uczenia maszynowego (ML) najczęściej rozwiązują jasno zdefiniowane zadania – na podstawie danych wejściowych przewidują konkretny wynik. Jeśli model klasyfikuje obraz, można jednoznacznie ocenić, czy wynik jest poprawny.

W przypadku modeli językowych sytuacja wygląda inaczej. Nie zwracają jednego, określonego wyniku, lecz generują odpowiedzi, które mogą być poprawne na wiele sposobów. To samo zapytanie może dawać inne rezultaty, a każda z odpowiedzi może różnić się stylem, szczegółowością czy interpretacją.

Nie istnieje więc jeden wzorzec, do którego można porównać wynik. Defekty są trudniejsze do wychwycenia, a ich charakter często nie jest jednoznaczny. Przejście od predykcji do generowania zmienia więc sposób projektowania, testowania i utrzymania aplikacji.

Czym jest LLMOps

LLMOps obejmuje cały cykl życia modeli językowych – od danych uczących po monitoring. Jego celem jest utrzymanie jakości działania rozwiązania w warunkach produkcyjnych, gdzie liczy się nie tylko to, czy model odpowiada, ale jak odpowiada i czy robi to w sposób powtarzalny.

Oznacza to, że model musi:

- działać stabilnie mimo zmienności odpowiedzi,

- dostarczać treści użyteczne i zgodne z kontekstem,

- mógł być rozwijany bez utraty jakości i kontroli nad zmianami.

LLMOps bazuje na praktykach znanych z MLOps, ale rozszerza je o elementy specyficzne dla modeli generatywnych. Pojawia się tu potrzeba zarządzania promptami jak kodem, oceny jakości tekstu zamiast jednego wyniku oraz pracy z aplikacją, której odpowiedzi nie są w pełni deterministyczne.

Cykl życia modelu językowego

System oparty na modelu językowym powstaje etapami. Punktem wyjścia są dane uczące, zazwyczaj tekst, które wymagają oczyszczenia, uporządkowania i weryfikacji. To właśnie na tym etapie zapadają decyzje, które później przekładają się na jakość generowanych odpowiedzi, dlatego jakość danych wejściowych ma duże znaczenie.

Kolejnym krokiem jest dopasowanie modelu do konkretnego zastosowania. Odbywa się to na kilka sposobów: poprzez precyzyjne projektowanie promptów, dostrajanie modelu do wybranego zadania lub uzupełnianie jego wiedzy o zewnętrzne źródła danych. Dobór podejścia zależy od potrzeb biznesowych oraz dostępnych zasobów.

Następnie pojawia się etap ewaluacji, który w przypadku modeli językowych wymaga szerszego spojrzenia niż w klasycznych oprogramowaniach. To właśnie tutaj weryfikujemy, czy rozwiązanie działa zgodnie z oczekiwaniami.

Po wdrożeniu aplikacja wymaga stałego monitoringu, obejmującego zarówno elementy techniczne, jak i jakość generowanych treści, koszty działania oraz zachowania użytkowników. Wychwytujemy wtedy szybko problemy i reagujemy na zmiany.

Cały proces ma charakter iteracyjny. Wnioski z monitoringu stają się podstawą do dalszych usprawnień, a kolejne wersje aplikacji powstają w oparciu o zebrane dane i doświadczenia.

Poziomy wdrożenia modeli językowych

Organizacje wykorzystują modele językowe na różnym poziomie zaawansowania, w zależności od potrzeb, dojrzałości technologicznej i dostępnych zasobów. Wyróżniamy trzy główne podejścia, które różnią się stopniem kontroli nad systemami oraz kosztami ich utrzymania.

Najprostszy wariant to korzystanie z gotowych modeli poprzez interfejsy API. Da się wówczas szybko uruchomić rozwiązanie bez konieczności budowania własnej infrastruktury czy trenowania modeli. W wielu przypadkach wystarczy odpowiednio zaprojektować prompty i logikę aplikacji, aby uzyskać użyteczne rezultaty. Ograniczeniem jest jednak mniejsza kontrola nad zachowaniem modelu, zależność od dostawcy oraz trudność w zapewnieniu powtarzalnej jakości odpowiedzi.

Kolejny poziom to dostosowanie istniejących modeli do konkretnych potrzeb. Może to przyjmować różne formy – od fine-tuningu, czyli dotrenowania modelu na własnych danych, po podejścia oparte na dostarczaniu kontekstu, takie jak Retrieval-Augmented Generation (RAG). Rozwiązanie może lepiej odpowiadać na specyficzne pytania i korzystać z aktualnej wiedzy organizacji. Takie rozwiązania wymagają jednak przygotowania danych, budowy mechanizmów ewaluacji oraz utrzymywania większej liczby komponentów.

Najbardziej zaawansowane podejście polega na trenowaniu własnych modeli od podstaw lub na głębokiej modyfikacji istniejących architektur. Daje to największą kontrolę nad jakością, bezpieczeństwem i kosztami działania w długim okresie, ale wiąże się z bardzo dużymi nakładami – zarówno obliczeniowymi, jak i organizacyjnymi. To rozwiązanie stosowane jest głównie przez największe organizacje lub w projektach o wysokich wymaganiach regulacyjnych.

Większość zespołów porusza się między tymi poziomami, łącząc różne podejścia. Niezależnie od wybranej strategii, ważne pozostaje zapewnienie kontroli nad jakością odpowiedzi, kosztami oraz możliwością rozwoju rozwiązania w czasie.

Komponenty LLMOps

Modele językowe wprowadzają nowe elementy, które nie występowały w klasycznych aplikacjach ML. Oprócz samego modelu pojawia się warstwa operacyjna, która decyduje o tym, czy rozwiązanie będzie użyteczne i możliwe do utrzymania w dłuższym czasie.

Jednym z najważniejszych komponentów jest projektowanie promptów. Sposób formułowania zapytania bezpośrednio wpływa na jakość odpowiedzi, a nawet drobne zmiany mogą przynosić inny skutek. Z tego powodu prompty traktuje się jak kod – są wersjonowane, testowane i rozwijane wraz z systemem.

Tzw. embeddingi pomagają z kolei przekształcić tekst w reprezentację liczbową. Dają one możliwość wyszukiwania podobnych treści i budowania aplikacji łączących generowanie odpowiedzi z bazą wiedzy. Takie podejście, znane jako RAG, umożliwia modelowi korzystanie z aktualnych danych bez konieczności jego ponownego trenowania.

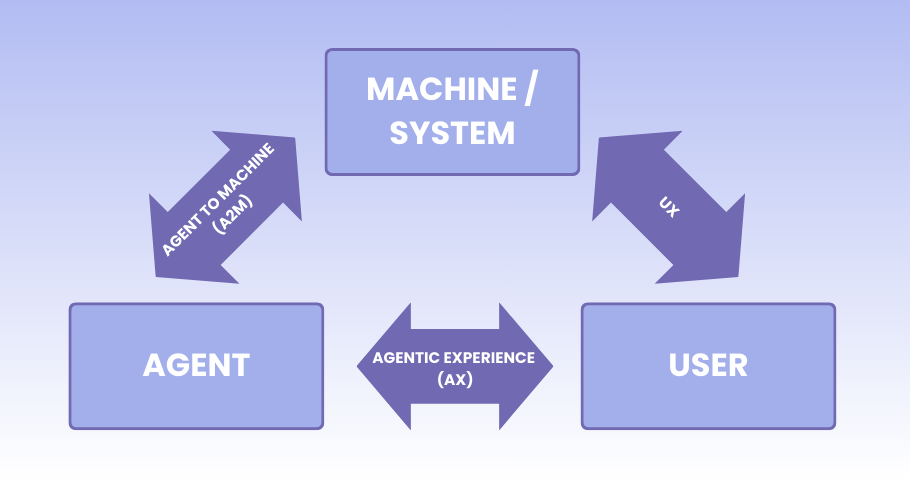

W bardziej złożonych rozwiązaniach wykorzystuje się łańcuchy i agentów. Zamiast pojedynczego zapytania tworzy się wieloetapowe procesy, w których model realizuje kolejne kroki, na przykład analizuje problem, wyszukuje informacje, a następnie generuje odpowiedź. Każdy etap może być kontrolowany, testowany i monitorowany osobno, co ułatwia zarządzanie złożonością systemu.

Modele językowe zmieniają sposób budowy systemów, ale to dopiero początek problemów. Największe wyzwania pojawiają się w momencie, gdy trzeba ocenić jakość odpowiedzi, monitorować działanie systemu i reagować na zmiany.

W drugiej części pokażemy, jak mierzyć jakość modeli językowych, jak wygląda monitoring w praktyce oraz z jakimi problemami mierzą się zespoły pracujące z LLM na co dzień.

Redakcja

Redakcja